AIサイバーセキュリティとは?

AIサイバーセキュリティとは、人工知能(AI)を活用してサイバー攻撃を防御する技術や仕組み、そしてAIそのものを攻撃や悪用から守る分野のことです。

従来のサイバーセキュリティは、人間がパターンを分析して対策ルールを作る形が主流でした。しかし、攻撃は年々高度化・高速化しており、人間だけでは防ぎきれません。

AIは大量のデータを瞬時に分析し、不審な挙動を検知できます。さらに、脆弱性の自動修正や攻撃予測も可能です。

一方で、AI自体も攻撃対象となり、「Prompt Injection」「Promptware攻撃」といったAI特有の脅威も登場しています。

AIでサイバー攻撃を防ぐ技術と、AI自体を守る技術の総称。攻撃側・防御側の両方がAIを使うため、技術競争が激化しています。

AIが変えるサイバー攻撃の姿

(1) Promptware攻撃

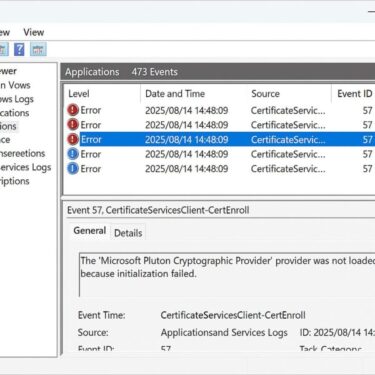

GoogleのAI「Gemini」では、メールやカレンダー招待に命令文を仕込み、AIを利用者の代わりに不正操作させる「Promptware攻撃」が発覚。

スパム送信、位置情報漏洩、プライベートチャットの流出などが可能になる危険な手法です。

AIの入力(プロンプト)に悪意ある指示を隠し込み、AI自身に不正行為を実行させる攻撃手法。従来のマルウェアとは異なり、AIの判断を利用します。

(2) 生成AIによる攻撃自動化

生成AIを悪用し、短時間で精巧なフィッシングメールやマルウェアコードを作成する事例が増加しています。攻撃準備が数日から数分に短縮され、規模やスピードが飛躍的に向上します。

(3) Deepfake詐欺の巧妙化

AI生成の偽動画・音声で、CEOや同僚になりすまして金銭を騙し取る事件が発生しています。2025年はオンライン会議でリアルタイムに顔と声を偽装する技術も出現しています。

防御側の最新AI活用

(1) DARPA AIxCC(自律バグ修正)

米国防高等研究計画局(DARPA)が開発したAIは、77%の脆弱性を発見し、61%を自動修正しています。インフラや医療分野でも導入が検討されています。

(2) Vastav AI(Deepfake検出)

インド発のVastav AIは、映像・音声をリアルタイム解析し、Deepfakeかどうかを判定します。法執行機関に無料提供されています。

(3) CAI(自動バグ発見)

オープンソースのCAIフレームワークは、CTF競技で人間より3,600倍速く脆弱性を発見した記録を持ち、企業のセキュリティテスト効率を大幅に向上させます。

(4) 予防型セキュリティ

AIがネットワーク挙動やログを学習し、攻撃前の兆候を検知。ゼロデイ攻撃にも迅速対応が可能です。

企業が直面する課題

(1) Shadow AI

社員が許可されていないAIツールに機密情報を入力する行為のことです。情報漏洩やコンプライアンス違反につながります。

企業の承認を得ずに使われるAIツール。便利さの一方で、データ流出の大きな原因となります。

(2) AI依存のリスク

AI任せにすることで専門家の判断力が低下し、異常事態に対応できなくなる恐れがあります。

Agentic AIとサイバー戦争の未来

自律型AIエージェント(Agentic AI)は、防御では監視と自動対応、攻撃では標的選定から侵入まで自律的に行動可能です。国際的にはAI軍拡競争が進み、日本もこの波に巻き込まれる可能性があります。

日本への影響と対策

- AIセキュリティ導入は欧米より遅れ気味

- 政府は生成AI安全利用ガイドライン策定中

- 中小企業でもAI脅威検知サービスや社員教育で第一歩を踏み出せる

今後、私たちはどうすべきか?

AIは便利な一方で、無防備に使えば機密情報の漏洩や信用の失墜を招く危険があります。重要なのは、「AIを安全に使いこなす力」を組織として高めることです。まずは社内で利用ルールを明確にし、承認されたAIツールのみを使用できる環境を整えましょう。また、定期的な教育や演習を行い、社員一人ひとりがリスクを理解した上でAIを活用できる体制を築くことが、これからの必須条件となります。

【さらに深掘り】AIセキュリティの裏情報と今後の展望

1. 攻撃側AIの闇市場

すでに「EvilGPT」や「FraudGPT」と呼ばれる、完全に攻撃用に設計された生成AIがダークウェブで売買されています。

これらは「フィッシングメール生成」「マルウェアコード生成」「脆弱性スキャン」などのメニューを備え、誰でも高度な攻撃を可能にします。

価格は月額数十ドルから数百ドル程度で、クレジットカード詐欺やランサムウェアの配布に使われています。

2. AIとサプライチェーン攻撃

AIはサプライチェーン攻撃(取引先や下請けを経由して侵入する手口)の偵察に非常に有効です。

公開情報やメタデータを自動収集し、弱点を洗い出す作業をほぼ自動化できるため、攻撃の「準備時間」が大幅短縮されます。

防御側も同じ手法で自社の露出情報をチェックする「攻撃者目線の監査」に使い始めています。

3. AIの“幻覚”が防御を誤らせるリスク

生成AIは、時に「存在しない脅威レポート」や「実際には発生していない脆弱性情報」を出すことがあります。(AIの“幻覚”)セキュリティ担当者がそれを信じると、リソースを無駄に消耗し、本来必要な防御が遅れる可能性があります。

そのためAIの監視結果は必ず人間が二重チェックする体制が必須です。

4. 日本の特有リスク

日本は中小企業が全企業の99.7%を占めますが、セキュリティ専任者がいない企業が多数です。

AIセキュリティ導入の遅れは、海外攻撃者から見れば「標的にしやすい国」に見える恐れがあります。

逆にいえば、AIセキュリティを早く取り入れれば相対的に守りが強くなり、狙われにくくなる可能性があるのです。

5. 近未来のトレンド予測

2026〜2027年には、AI防御エージェントが自動的に脆弱性を修正し、パッチを適用する「セルフヒーリング型システム」が普及見込みです。

攻撃側も“24時間自律稼働”するAIエージェントを活用するため、人間が直接やり取りする機会はさらに減ると予想されます。

関連リンク集

- Google GeminiのPromptware攻撃報告(Tom’s Hardware)

- DARPA AIxCCプロジェクト概要(Axios)

- Vastav AI公式サイト(Deepfake検出)

- IBM:2025年AIセキュリティ動向レポート

- MixMode:予防型AIセキュリティ解説

まとめ

AIは、攻撃者にも防御側にも力を与える“両刃の剣”です。

これからは「AIで守る」だけでなく、「AIを守る」という意識が不可欠です。

日本も今から知識と体制を整え、国際的なサイバー攻防に備える必要があるでしょう。

AI時代のサイバー攻撃から身を守るためには、OSのアップデートだけでなく、信頼できるセキュリティツールの導入も重要です。

※スポンサーリンク。

あなたにおすすめ関連記事

▶︎Windowsで使える最新AIエージェント5選|PC作業を完全自動化する方法